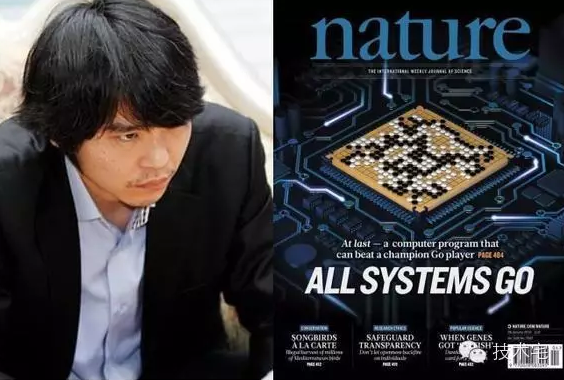

1月28日,国际顶尖期刊《自然》报道了谷歌研究者开发的新围棋AI。这款名为“阿尔法围棋”(AlphaGo)的人工智能,在没有任何让子的情况下以5:0完胜欧洲冠军,职业围棋二段樊麾。

这是第一次围棋程序全方位的击败一位专业棋手。虽然他只有二段,但是他和李世石之间的差距也只在让一两个子之间。这让人们不得不担心,今年三月接受AlphaGo挑战的李世石,能否拿到谷歌的100万美元奖金。

3月,AlphaGo挑战李世石

谷歌团队在Nature论文摘要中写道“我们引入了一个新的搜索算法,结合蒙特卡罗模拟的价值和策略网络。通过该算法,我们的程序对其他的围棋程序的495局对抗中达到99.8%的获胜率,并以5比0击败人类欧洲冠军。

作为一种复杂程度最高的棋类游戏,围棋被看作是在人工智能面前捍卫人类尊严的最后防线。但是自从深蓝战胜卡斯帕罗夫之后,人们都知道人工智能在围棋上战胜人类的这一天迟早来,但没想到这么快。按照传统的人工智能计算方法,现在的计算能力绝对达不到战胜专业棋手的能力。

这是因为传统的人工智能方法是将所有可能的走法构建成一棵搜索树,然后在其中搜索最优的下法。但是对于围棋来说,这颗搜索树过于巨大,其面临的可能性数量,甚至超过宇宙中所有原子的总和。

但是谷歌的团队在传统的方法之上,加入了深度神经网络,其中最重要的两层决策步骤,一个使用“决策网络”(policy network)负责选择下一步走法,一个是使用“值网络”(“value network)判断这步棋所导致的最后胜负结果。靠着更精准的评估和更聪明的棋步选择,这种算法与人类的思维方式更接近,计算量实际上比20年前的深蓝计算机还要少几千倍。

之所以能够达到精准的评估,关键是它不仅仅是一种算法,而且拥有自我学习的能力,从人类围棋高手的几十万局棋谱中,它掌握了如何赢棋的规律。这就是说,人工智能已经从人类历史上几乎所有围棋高手的棋谱上学习了经验,这样它的落子就不仅仅靠计算。就像很多高手一样,更多的是看棋形,看定式,然后比拼的才是计算能力。

之所以在之前的人工智能程序只能达到业余的水平,是因为虽然计算机本身的计算步数,搜索深度本身已经超过了人类棋手,但是他们没有经验,只知道傻算,但是这样还是算不过拥有更多经验的专业棋手,但是当人工智能也拥有了同样甚至更多的经验之后,战胜专业棋手就不在话下了。

那么李世石是不是同样战胜不了AlphaGo,很多人有这种担心。首先李世石要想战胜计算机,就要像计算机了解李世石的棋风一样,了解计算机的棋风,然后找到克制它的策略,在这一点上,人的能力还是要远远超过计算机。

当然李世石也不是没有输给计算机的可能,但这只能说明,计算机在计算能力、记忆能力上超过了人类,但这跟人类的智慧失守,还扯不上一点关系。

让计算机模拟人类、战胜人类,实际上从计算机诞生后不久的时候,很多人就有了这种想法。1946年世界上第一台电子数字计算机ENIAC出现,此后维纳建立了控制论,香农建立了信息论,模拟人脑看似不再遥远。

ENIAC

1956年美国的几位心理学家,数学家,计算机科学家和信息论学家在达特茅斯大学召开了会议,提出了人工智能这一学科。此后“认知模拟”,“语意信息理解”,“专家系统”等名词,开始陆续出现。

但是人工智能领域推进了十几年后,到上世纪70年代就到达了第一次低潮,因为大家对它的期望过高,但是实际上计算机本身发展水平和预期距离太大。到了70年代末、80年代初,人工智能的重点开始从推理转向知识工程,人工智能实现了第二次崛起。但这主要开始依靠计算机越来越强大的计算能力和存储能力完成的。

当时日本就提出了雄心勃勃的第五代计算机计划,希望创造能把信息采集、存储、处理、通信同人工智能结合在一起的智能计算机系统,具有形式化推理、联想、学习和解释的能力,能够帮助人们进行判断、决策、开拓未知领域和获得新的知识。

到了上世纪末,这一计划宣告失败。尽管这项计划在技术上取得了部分突破,但最终没能攻克关键性的技术难题。使得第五代计算机基本丧失了商业价值,产业化更是无从谈起。

最关键的问题,是当时的计算机不能进行联想、推论、学习等人类头脑的最普通的思维活动,虽然它能在一定程度上配合、辅助人类的脑力劳动,但它还不能真正听懂人的说话,读懂人的文章,还需要由专家用计算机懂得的特殊的“程序语言”同它进行“对话”。

最近人工智能又开始热了起来,其中标志性的事件就是谷歌收购机器人厂商波士顿动力公司,收购深度学习技术公司Deepmind,而后者就是研发AlphaGo人工围棋程序的主力。此外,facebook,IBM也都在开发深度学习和机器认知,尝试让计算机获得更多“人性”。

这一轮的崛起,主要依赖于硬件计算能力的发展,云计算的分布式架构,大数据平台的成熟,依靠深度神经网络,将机器学习算法进入实用化。

但是在为计算机注入人性方面的进展,还乏善可陈。前几天,牛津大学的信息哲学与伦理教授Luciano Floridi在一次研讨会上就提出,现在的计算机还都是图灵机,也就是按照既定的程序,为既定的输入完成相应的输出,而图灵机是没法理解、没有意识更没有直觉。它在智力上,还不如一只老鼠。

Luciano Floridi

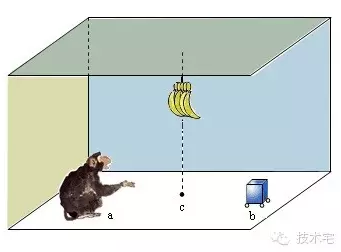

可以说,人的创造性,无法用机器代替。举一个例子,如果在一个屋子里挂一个香蕉,地上摆一个箱子,这时候猴子就会把箱子搬到香蕉下面,把香蕉拿下来。但是这么简单的方法,到现在已经是60个年头,已经可以在围棋上战胜人类的人工智能,还是想不出来。

猴子与香蕉问题

Floridi的这句话,可以说是对马斯克、霍金等人对于人工智能威胁的言论的一种回击。在后者看来,人类最大生存威胁,可能是人工智能,研究人工智能如同在召唤恶魔。

正如Facebook人工智能实验室主任,NYU计算机科学教授Yann LeCun 所说,有些人是因为对人工智能的原理不理解导致恐惧,有些人是为了个人名望宣扬人工智能威胁论,而有些人是为了商业的利益推动人工智能威胁论。

Luciano Floridi看来,霍金和马斯克的言论,可能是被摩尔定律所迷惑,而摩尔定律所代表的进步速度,只是计算能力的进步速度,而不是人工智能的进步速度。对于超级智能机器的恐慌,实际上是站不住脚的。

现有的智能技术,和真正的全面战胜人类的超级智能之间的差距,就像是你爬上了一棵树,就以为你登上了月球,但是你只能爬这么高了。在他看来,最大的问题不是机器,而是人,而人的问题要可预见的未来一直持续下去。

对于谷歌程序战胜围棋冠军这件事,在线围棋教育开发项目的围棋业余5段,这样评价,这并非是计算机打败了人类。

李喆七段也这样评价,“工具无善恶,善恶在人心。未来的路通往何方,将由我们自己决定。”

前几天在上海听了一个人工智能研讨会,在这次会上,上海机器人学会理事长钱晋武的一句话就说的更加直接。他说,机器人不可能比人更坏。如果有人做坏机器人,肯定是坏人,好人比坏人多,肯定是好机器人多。

在他看来,逻辑思维不可能产生创造性思维。还没有人知道,创造性思维是怎么来的。200年之内,不可能做出跟人一样的机器来。如果要做出来,必须要先把人研究透。

如果说计算机超越人类,实际上机器人早就在力气上、精准度上超越了人类,哪个人能够说,脑子里可以装下整个大英博物馆。但是要说全面超越人类,在可以预见的将来,还看不到这个可能。

问题最大的还是人,最危险的,还是人本身。

0

推荐

京公网安备 11010502034662号

京公网安备 11010502034662号